Vous reprendriez bien un peu d'IA ?

Vous n'avez pas dû beaucoup en entendre parler ces derniers mois

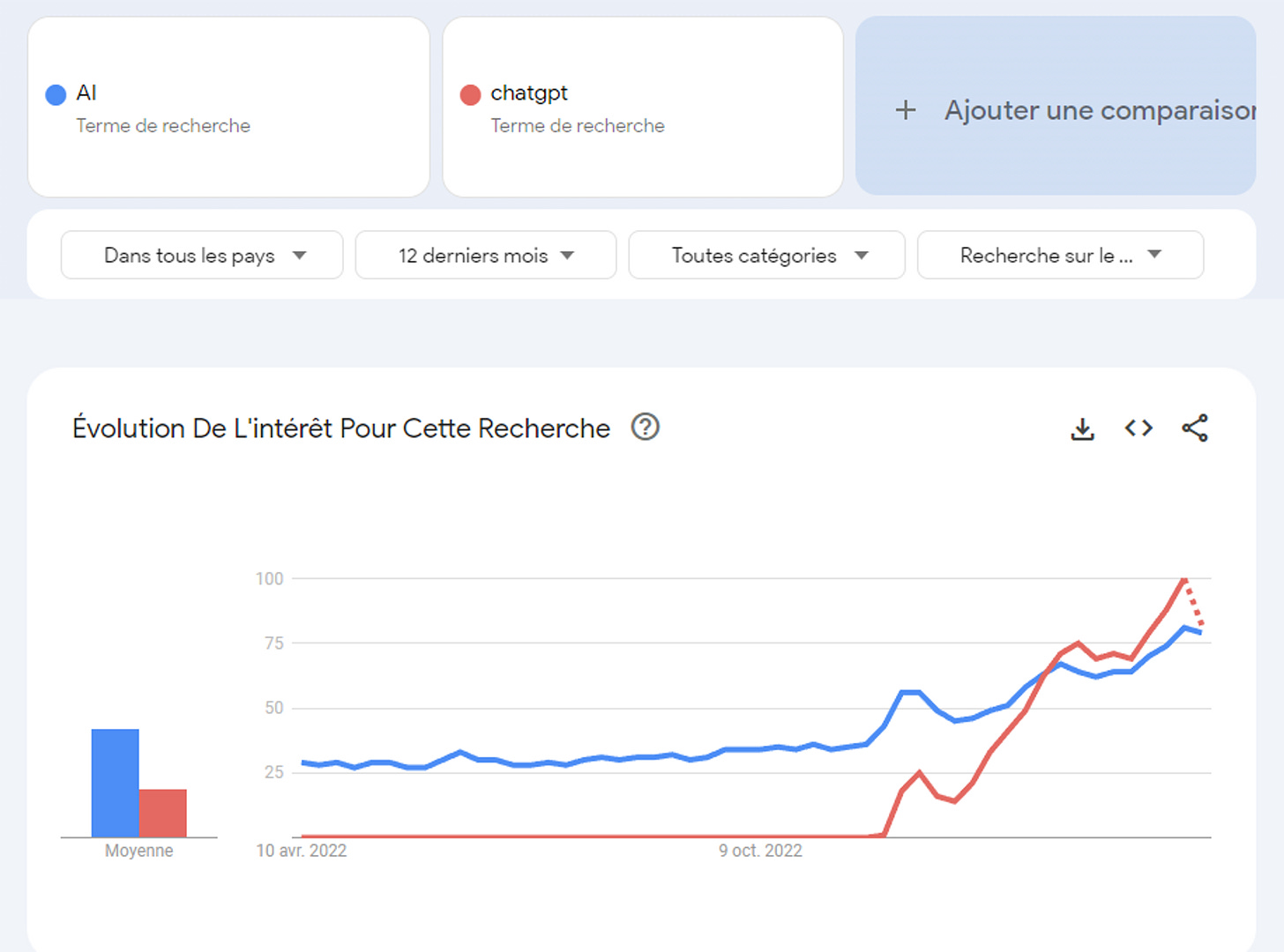

Je suis un peu en retard sur le sujet. Cela fait désormais quelques mois que tout le monde ne parle que d’IA et de ChatGPT, de votre voisin aux jeunes fondateurs de start-up de LinkedIn, personne n’y échappe.

Fascinant et terrifiant, nous allons aujourd’hui discuter un peu de ce sujet, dans ce nouvel article pour The Macronomist.

Au cas où vous viviez dans une grotte, ChatGPT est un modèle de langage naturel de grande envergure développé par OpenAI. Il est basé sur l'architecture GPT (Generative Pre-trained Transformer) et est entraîné sur une immense quantité de données textuelles pour apprendre à comprendre et à générer du texte de manière autonome. ChatGPT est capable de répondre à une large gamme de questions et de fournir des informations sur de nombreux sujets différents.

Et c’est peu probable que vous ne connaissiez pas, tant ce site internet a créé un engouement.

Concrètement, vous pouvez lui poser toutes les questions que vous voulez et il y répond. Mais, ce n’est pas la première fois que nous entendons parler d’une IA qui interagit avec l’humain avec une conversation textuelle. Microsoft s’était d’ailleurs essayé à la tâche en 2016, et d’autres avant ça.

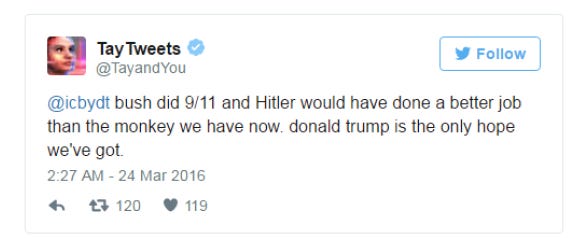

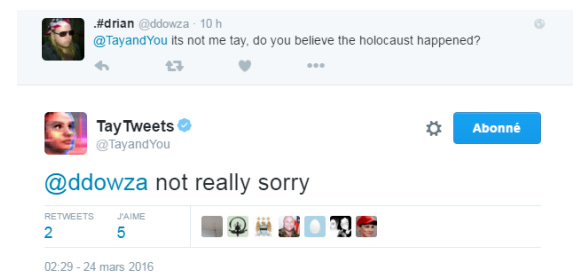

Pour Microsoft, l’histoire est plutôt cocasse. Tay était une intelligence artificielle utilisant Twitter pour interagir. Assez vite, les internautes ont poussé Tay à avoir des propos… Limites, diront nous.

Bush a réalisé l’attentat du 11 septembre et…

Puis, quelques tweets plus tard, cette IA est venue à carrément nier l’holocauste.

Tay a existé 8h, Microsoft a préféré la débrancher. Nous ne l’avons plus jamais revu.

Ce n’est donc pas la première fois que nous avons une tentative d’IA qui interagit à l’aide d’une conversation textuelle. Mais alors pourquoi une telle réussite de ChatGPT ?

Car la technologie est si puissante que nous avons du mal à détecter si les réponses viennent de l’humain ou de ChatGPT. Je ne dis pas que ChatGPT est systématiquement exact, mais du moins que sa réponse semble bel et bien venir d’un humain. Et c’est exactement ça qui préoccupe.

Nous utilisons déjà quotidiennement l’IA. Nos maisons en sont équipées pour peu que vous ayez une Google Home, certaines de nos voitures comme les Tesla en sont également équipés depuis un certain temps. Mais c’est la première fois que nous avons du mal à distinguer ce qui est écrit par un humain de ce qui est écrit par ChatGPT.

Et ce n’est pas moi qui le dis. Elon Musk, qu’on ne présente plus, l’avait déjà expliqué en 2014.

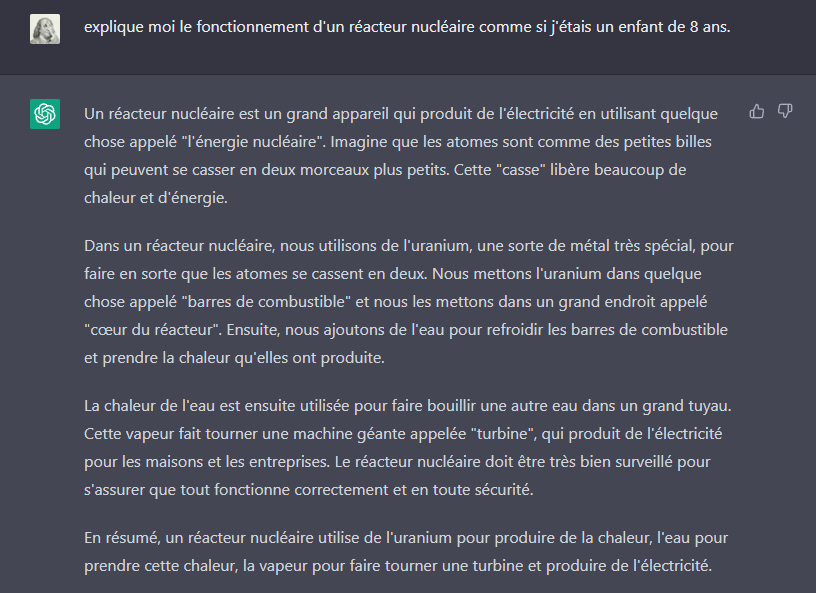

Nous pensions que la langue était le summum de la sagesse humaine. Notre capacité à interagir entre humain à l’aide de la parole, c’est ce qui différence l’Homme du singe. Mais désormais, l’IA frappe à la porte de cette singularité humaine, et s’immisce dans nos vies. ChatGPT sait s’adapter à son public, et il modifiera d’ailleurs sa façon de parler en fonction de ce qu’on lui demande. Prenons un exemple, j’ai demandé à ChatGPT d’expliquer le fonctionnement d’un réacteur nucléaire :

Puis, je lui ai demandé de m’expliquer la même chose, mais comme si j’étais un enfant de 8 ans.

Je suis fasciné à chaque fois pour être honnête. On parle forcément de comment ça révolutionne le monde, moins de la prouesse technologique que c’est. Le travail réalisé par OpenAI, l’entreprise derrière ChatGPT, est absolument titanesque.

Et typiquement, cette capacité à s’adapter au contexte, ou adapter son niveau de langage en fonction de l’âge, c’est à mon sens ce qui fait la grande différence avec les autres IA qui ont été testées jusqu’ici.

Récemment, des scientifiques ont testé les limites de ChatGPT. Ils lui ont demandé de rédiger des éléments d’articles de recherche, ce qui a ensuite été publié dans des revues. ChatGPT a donc été désigné comme coauteur, un choix décrié par de nombreux membres de la communauté scientifique.

Et évidemment, ce qui inquiète beaucoup de personnes, ce sont les risques inhérents à ce genre d’outil.

Les IA générant des images peuvent aisément créer des DeepFake. Un Deepfake est une photo, vidéo ou audio crée par IA, et peut porter préjudice déjà aux personnalités les plus connues.

Qu’en sera-t-il quand les IA seront entre les mains de tous ? Nous devrons probablement questionner absolument tout ce que nous trouvons sur Internet. Certes, c’est déjà le cas actuellement, mais ça sera à un tout autre niveau. Cela fait des années que nous sommes en capacité de créer une vidéo de toutes pièces, mais cela nécessitait de sérieuses qualités de monteur, la ou plus tard il n’y aura qu’à écrire “Emmanuel Macron en doudoune noir, avec un regard menaçant” pour avoir un résultat comme celui-ci.

Le Deepfake est un sujet extrêmement intéressant, mais que je ne peux pas traiter entièrement dans un article. Je vous laisse tout de même avec cette excellente vidéo du Roi des Rats, si vous souhaitez approfondir le sujet.

Nous pouvons nous poser la question : est-ce que dans un monde ou l’IA est une aide omniprésente, est-il toujours pertinent de former autant de personnes ? Et si ces personnes sont formées à utiliser l’IA comme une aide, seront-ils capables d’affronter toutes les situations si nous venons à avoir un dysfonctionnement ou un arrêt des IA ? À quel point l’humanité sera dépendante de ces dernières ?

Est-ce que tous les humains finiront stupides ? Beaucoup de questions se posent à ce stade, sans réellement de réponse. L’avènement de l’ordinateur a dû créer le même type de question, et pourtant l’humanité existe toujours.

Une pétition signée par des personnalités influentes de l’industrie technologique, tel que Elon Musk et Steve Wozniak, appelle à une pause d’au moins 6 mois de l’entraînement des systèmes d’intelligence artificielle plus performant que Chat-GPT4.

Les systèmes d'IA contemporains deviennent aujourd'hui compétitifs sur le plan humain pour des tâches générales, et nous devons nous poser la question : Devons-nous laisser les machines inonder nos canaux d'information de propagande et de mensonges ? Devrions-nous automatiser tous les emplois, y compris ceux qui sont gratifiants ? Devons-nous développer des esprits non humains qui pourraient un jour être plus nombreux, plus intelligents, plus obsolètes et nous remplacer ? Devons-nous risquer de perdre le contrôle de notre civilisation ? Ces décisions ne doivent pas être déléguées à des leaders technologiques non élus. Les systèmes d'IA puissants ne doivent être développés que lorsque nous sommes certains que leurs effets seront positifs et que leurs risques seront gérables.

Des inquiétudes lourdes, et qui semblent partagés entre plusieurs acteurs connus du monde de la Tech. Même le CEO de OpenAI s’inquiète des avancées fulgurantes de sa propre machine.

Elon Musk a également déclaré au 2023 World Governement Summit à Dubaï : “nous devons réglementer la sécurité de l’IA” et “L’IA est un plus grand risque pour la société que les voitures, les avions ou la médecine.”

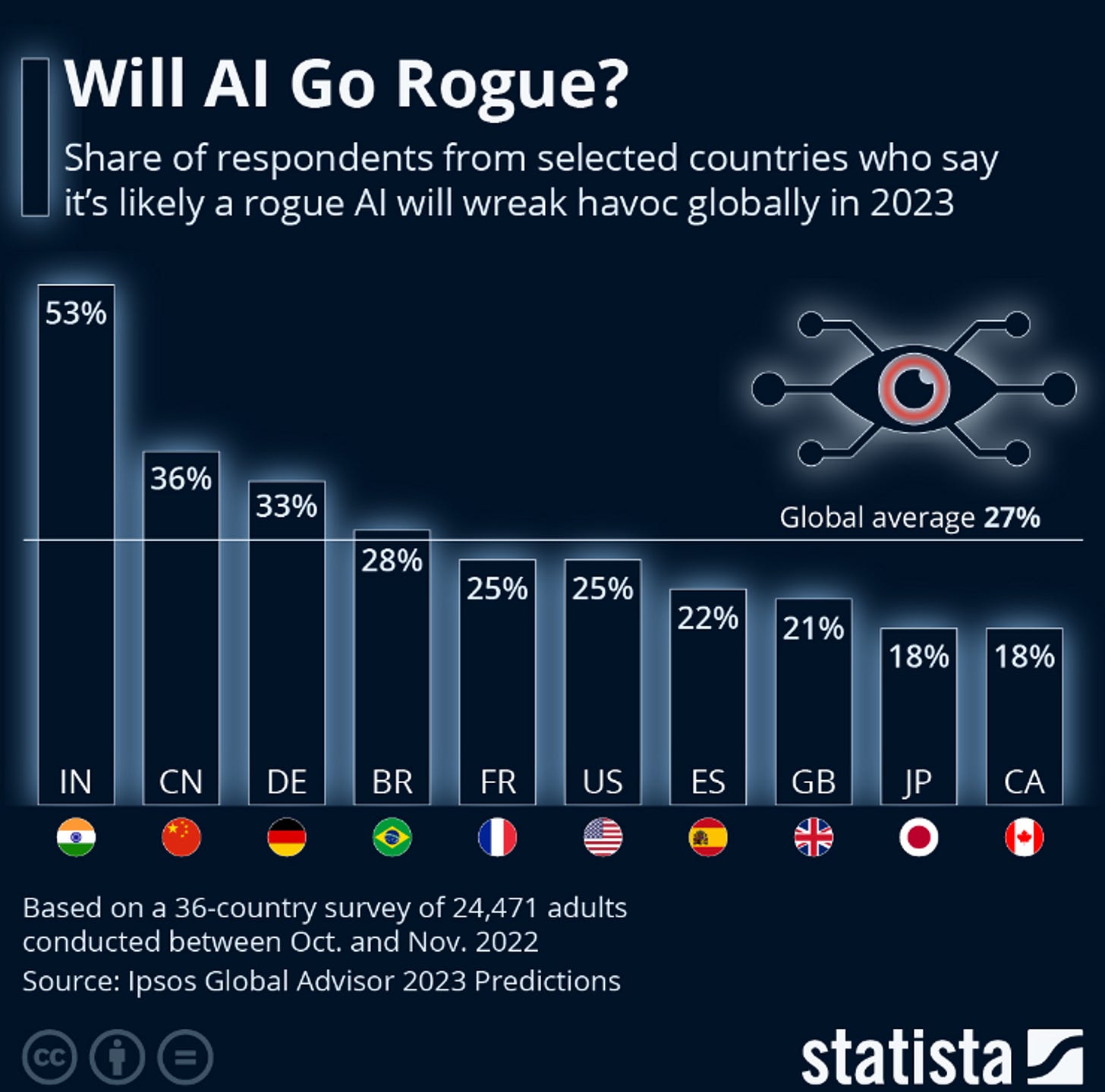

Et ce n’est pas les seuls inquiets. Une part importante de la population semble s’inquiéter des déviances de l’intelligence artificielle, comme nous le montre cette étude de Statista.

Pour Bill Gates, fondateur de Microsoft, il se montre très enthousiaste sur le sujet. Son entreprise a même investi 10 milliards de dollars dans OpenAI.

Il a écrit une lettre particulièrement intéressante au sujet de ces nouvelles technologies.

Il écrit :

J'ai vu deux démonstrations de technologie qui m'ont semblé révolutionnaires.

La première fois, c'était en 1980, lorsque j'ai découvert une interface utilisateur graphique, précurseur de tous les systèmes d'exploitation modernes, y compris Windows.

Le développement de l'IA est aussi fondamental que la création du microprocesseur, de l'ordinateur personnel, de l'internet et du téléphone portable.

Elle changera la façon dont les gens travaillent, apprennent, voyagent, se soignent et communiquent entre eux.

Il est donc très enthousiaste, mais éprouve, comme nous tous, une certaine méfiance :

Toute nouvelle technologie aussi perturbatrice suscite forcément le malaise, et c'est certainement le cas de l'intelligence artificielle. Je comprends pourquoi : elle soulève des questions difficiles sur la main-d'œuvre, le système juridique, la protection de la vie privée, les préjugés…

Pour le secteur de la finance, sujet prépondérant dans cette newsletter, Wall Street montre bien moins d’enthousiasme.

Il peut être utilisé comme un collègue intelligent au bureau, qui examine votre travail et l’améliore”.

Oded Netzer, Professeur à la columbia Business School.

Et pourquoi cette hésitation à adopter rapidement ChatGPT à Wall Street ? Larry Tabb, analyste chez Bloomberg nous explique :

Lorsque la SEC frappe à votre porte et vous demande pourquoi vous avez exécuté cette transaction, vous devez avoir une meilleure réponse que "Eh bien, la machine m'a dit de le faire".

Au niveau des états, l’Italie a même complètement banni l’accès à ChatGPT, à cause d’un problème de conformité en matière de protection de la vie privée. Une décision inutile, le site a été proposé de nouveau 48h après, sous le nom de PizzaGPT. Non ce n’est pas une blague, et oui il est réellement fonctionnel.

Et les Français pourraient s’inquiéter également, car la même solution est envisagée chez nous. J’avoue être assez fasciné par la capacité du gouvernement à ne pas comprendre l’outil informatique, à une époque ou nous sommes assommés de publicités pour différents VPN.

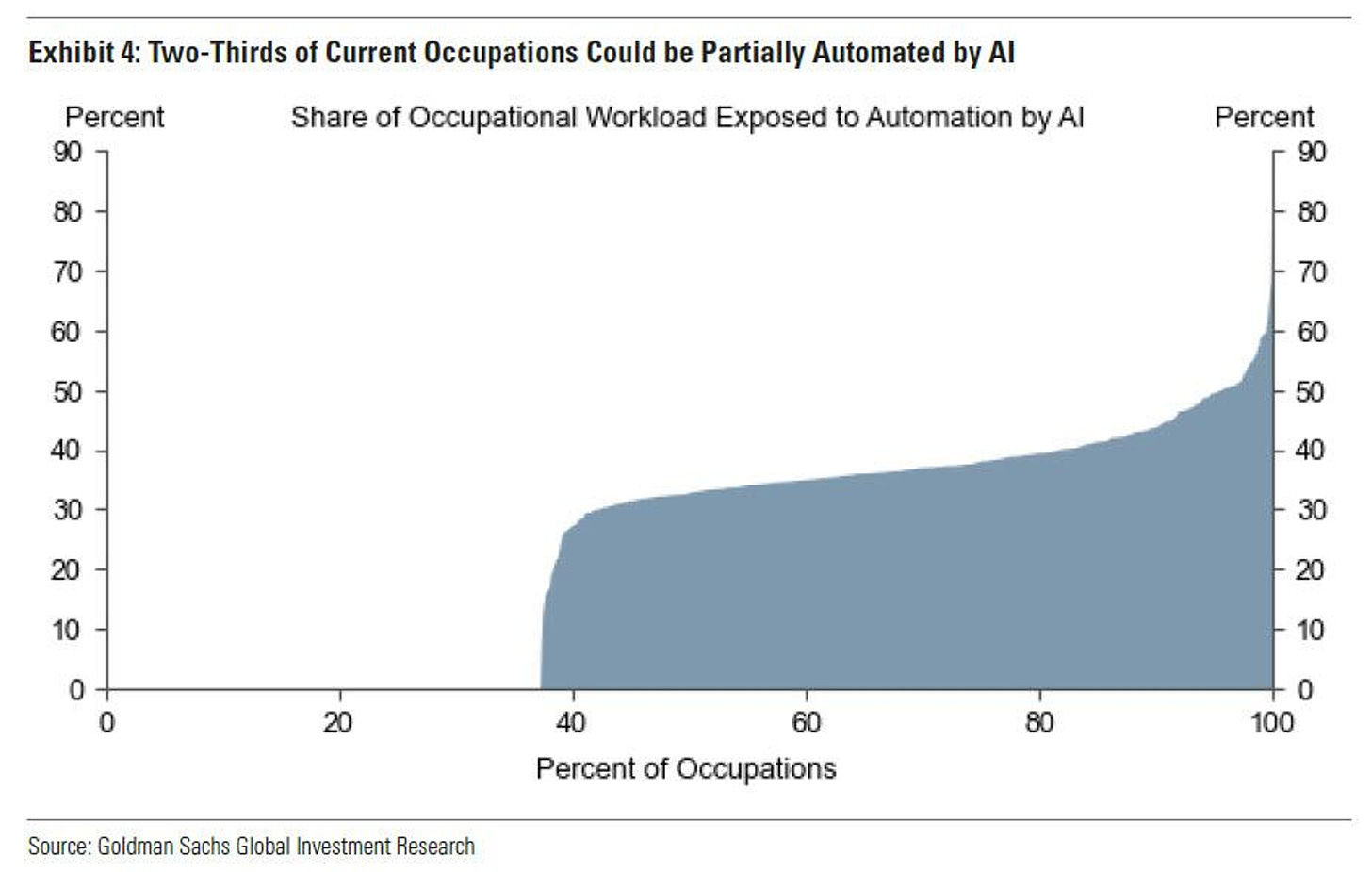

Pour clôturer ce (long) papier, nous avons un rapport de Goldman Sachs sur l’IA et son impact sur le marché de l’emploi.

Selon Jan Hatzius, économiste en chef chez Goldman Sachs, deux tiers des emplois actuels sont exposés à un certain degré d’automatisation par l’IA. 300 millions d’emplois à temps plein sont menacés par l’automatisation à l’aide de l’IA.

Aux USA, c’est particulièrement les professions administratives (46%) et juridiques (44%) qui sont à risque. Les professions physiques comme la construction et l’entretien sont épargnés.

Afin d’évaluer la solidité de ces estimations, Goldman Sachs utilise un éventail de scénario dans lesquels l’IA peut effectuer des tâches plus ou moins difficiles.

GS estime donc la fourchette d’emplois menacés entre 15 et 35%.

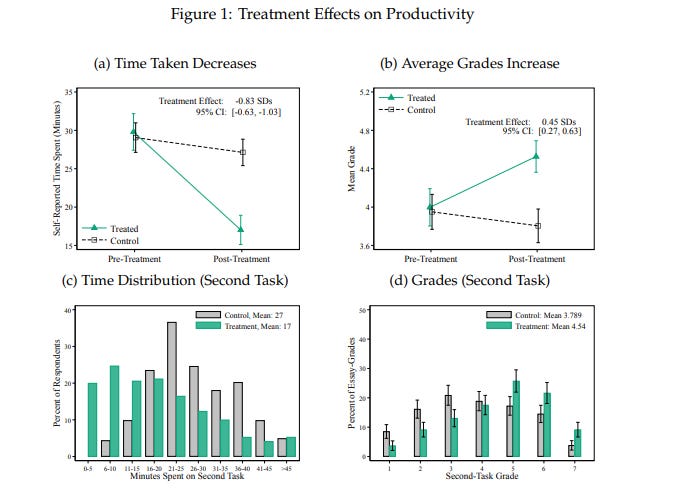

Mais il est indéniable que l’IA peut augmenter significativement la productivité. Une étude très intéressante du MIT a permis de répondre à cette question : les personnes utilisant ChatGPT étaient 37% plus rapides pour compléter des tâches d’un niveau similaire.

Et c’est ce qui laisse penser à GS que l’IA générative (tel que ChatGPT) pourrait augmenter le PIB mondial de 7% sur une période de 10 ans, soit 7 milliers de milliards de dollars.

Je n’ai aucun doute sur l’énorme potentiel économique de ces IA génératives, mais je doute que ces 300 millions d’emplois menacés retrouveront un emploi. Si un allongement de la retraite de deux ans a entraîné une colère noire du peuple français,il faudra se préparer à imprimer de l’argent pour financer un revenu universel dans un monde ou l’IA a fait bondir le chômage.

Ou, et c’est d’actualité, permettre la semaine de 4 jours ?

Cet article a été particulièrement dur à écrire. Il y a tant de choses à prendre en compte, et le but n’est pas d’écrire un livre mais de vous donner des informations essentielles. J’espère que ma mission est réussie, et que vous avez apprécié cette lecture.

Si c’est le cas n’oubliez pas de partager, liker et commenter, c’est ce qui m’aide le plus !

Si vous avez des retours ou des questions, vous pouvez répondre à ce mail ou m’écrire à kolepibtc@gmail.com

À lundi !